Künstliche Intelligenz als Zukunftsrezept: Irren ist menschlich

/ nic.at News - 26.03.2020 09:00

Künstliche Intelligenz als Zukunftsrezept: Irren ist menschlich

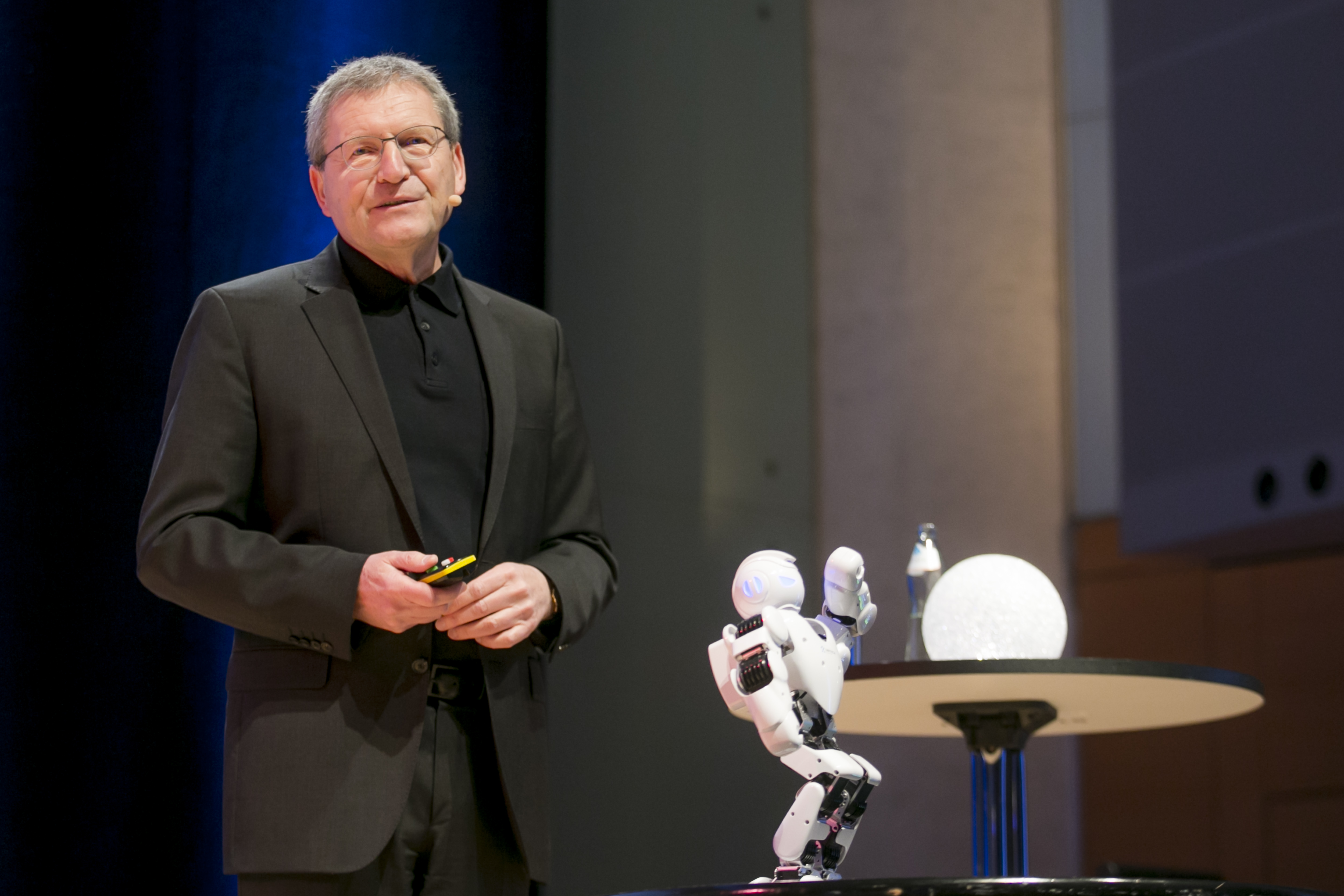

Manfred Müller ist Ausbildungskapitän bei der Lufthansa. Auf dem Domain pulse erklärt er, warum künstliche Intelligenz den Menschen nicht ersetzen kann und ein großes Hierarchiegefälle zu Gefahrensituationen führt.

Der Nebel ist dicht, eine Boeing 747 rollt langsam auf die Startbahn des kleinen Flughafens Los Rodeos auf Teneriffa. Die KLM-Maschine wendet, um in Startposition zu kommen. Kapitän Jacob Veldhuyzen van Zanten startet das Flugzeug – ohne Startfreigabe des Towers. Und das, obwohl sein Co-Pilot ihn auf die fehlende Freigabe hinweist. Doch Veldhuyzen van Zanten ignoriert ihn. Kurz vor dem Abheben der Maschine auf der Startbahn sieht er die Lichter einer entgegenkommenden Pan-Am-Maschine. Der Kapitän reißt das Flugzeug in die Höhe, doch der Aufprall ist nicht mehr zu verhindern. 583 Menschen sterben am 27. März 1977. Der Unfall ist einer der schwersten der zivilen Luftfahrt, eine Verkettung zahlreicher unglücklicher Umstände. Als einer der Hauptschuldigen des Unglücks gilt Veldhuyzen van Zanten, der selbst bei dem Unfall ums Leben kam. Er hatte bis dahin mehr als 11 000 Flugstunden absolviert, war Chefausbilder der niederländischen Airline KLM. Ein angesehener Pilot. Wie konnte ihm dieser folgenschwere Fehler passieren?

Defizite in der Teamarbeit

Manfred Müller verwendet auf dem Domain pulse in Innsbruck in seinem Vortrag „Errare humanum est: KI als Zukunftsrezept gegen menschliche Fehler?“ das Unglück auf Teneriffa als Beispiel für ein zu großes Hierarchiegefälle. Müller ist Ausbildungskapitän und Leiter der Flugsicherheitsforschung Deutsche Lufthansa AG. „Defizite in der Teamzusammenarbeit sind immer wieder dafür verantwortlich, dass aus einfachen Arbeitsfehlern Katastrophen entstehen können“, so Müller. Der Mensch im Team sei der entscheidende Faktor. So wie KLM-Kapitän Jacob Veldhuyzen van Zanten. „Der Pilot hatte nicht die Größe, seinen Fehler einzugestehen. Dabei hatte ein Kollege erkannt, dass es keine Startfreigabe gab, er traute sich aber nicht, seinen Vorgesetzten zu stoppen.“

Das Unglück auf Teneriffa hatte Nachwirkungen, man begann beispielsweise bei der Piloten-Ausbildung auch die Fähigkeit zur Teamarbeit zu schulen. Es brauche im Cockpit Strukturen und Hierarchie, allerdings sei es wichtig, auch rangniedrigere Besatzungsmitglieder in Entscheidungen einzubeziehen, so Müller. „Lieber einmal etwas zu viel sagen als einmal zu wenig.“ Dafür sei es als Führungskraft wichtig zu wissen, was für ein Vorgesetzter man sei. „Wird man als dominant und autoritär wahrgenommen oder eher als konfliktscheu? Und die wichtigste Frage ist: Wie kann ich das herausfinden?“, fragt Müller das Publikum in Innsbruck. Ein Zuhörer antwortet: „Man könnte seine Mitarbeiter fragen.“ Da schüttelt Müller den Kopf und sagt: „Diese Menschen stehen auf ihrer Gehaltsliste, es herrscht ein Abhängigkeitsverhältnis. Sie werden deshalb keine ehrliche Antwort bekommen.“ Die beste Möglichkeit sei es, den Lebenspartner zu fragen. „Das kann dann aber unangenehm werden“, so der Ausbildungskapitän.

Automationsgrad erhöhen

Der Mensch macht also Fehler. Sollte man deshalb nicht einfach den Automationsgrad erhöhen? „Die Hoffnungen, dass immer leistungsfähigere Computersysteme den Menschen ersetzen können, haben sich bisher nicht erfüllt. Durch die fortschreitende Automation wurde die Sicherheit nicht erhöht, allerdings nahm das mangelnde Training der Piloten zu“, sagt Müller. Denn man verlasse sich zu sehr auf den Computer. „Künstliche Intelligenz ist eine große Hilfe, aber wir dürfen sie nicht überschätzen.“ Es sei deshalb wichtiger, die menschliche Fehlerrate zu reduzieren. Der Ausbildungskapitän nennt wichtige Faktoren dafür: „Die Piloten müssen kritikfähig sein, es muss ein perfektes Hierarchiegefälle geben.“ Durch optimale soziale Interaktion könnten 80 Prozent aller Fehler entschärft werden. Die Akzeptanz der eigenen Fehlerhaftigkeit spiele dabei eine wichtige Rolle. „Hochrangige Mitarbeiter können sich Schwächen oft nicht eingestehen. Nach dieser Erkenntnis verzichte ich übrigens auf eine Chefarztbehandlung im Krankenhaus“, sagt Müller schmunzelnd.

„Beichtgeheimnis“ eingeführt

Zudem sei es wichtig, dass Fehler bekannt werden. „Fehler müssen gemeldet werden, damit wir sie in Zukunft vermeiden können. Deshalb dürfen sie nicht bestraft werden.“ Die Lufthansa führte deshalb ein „Beichtgeheimnis“ ein. „Wir geben den Piloten eine Garantie, dass er oder sie nicht verraten wird, wenn ein Fehler gemeldet wird“, so Müller. Dieses System habe sich bewährt.

Durch dieses Risikomanagement erhöhte sich die Sicherheit im Luftverkehr laut Müller innerhalb von wenigen Jahrzehnten um mehr als den Faktor 100. „Die Strategie kann in vielen anderen Branchen angewendet werden.“

Unser Tipp

Auch diese Artikel könnten spannend für Sie sein: